Le persone e le idee dietro gli occhiali del futuro: storie di ricerca dallo Smart Eyewear Lab

Gli occhiali: oggetti quotidiani di uso comune, ma anche protagonisti di una rivoluzione tecnologica che coinvolge diversi ambiti di ricerca, come la fotonica, l’elettronica, l’intelligenza artificiale e molti altri. Lo Smart Eyewear Lab, nato dalla collaborazione tra Politecnico di Milano ed EssilorLuxottica, è il cuore pulsante di questa trasformazione: qui, circa cento ricercatori si confrontano ogni giorno con le sfide che separano gli occhiali tradizionali dai dispositivi smart capaci di arricchire la nostra esperienza del mondo.

Dietro una montatura apparentemente semplice, si nasconde un ecosistema complesso di innovazione: sensori miniaturizzati, algoritmi di intelligenza artificiale, tecnologie di eye tracking e display olografici. All’intersezione tra i diversi stream di ricerca, tra cui Eye Tracking, Camera e sensoristica e Integrazione ottica, lavorano fianco a fianco per integrare hardware e software in uno spazio minuscolo, senza rinunciare al design e alla comodità.

Gli occhiali del futuro non saranno più solo accessori, ma daranno forma a nuovi modi di percepire, analizzare e interagire con la realtà. Saranno dei veri e propri assistenti digitali, capaci di comprendere il contesto, monitorare la salute, migliorare la comunicazione e proiettare informazioni direttamente davanti ai nostri occhi.

In questo secondo viaggio dentro Smart Eyewear Lab (trovate il primo racconto qui) ci siamo fatti accompagnare dai più promettenti ricercatori e dai docenti più esperti del Politecnico, che ci hanno raccontato come tra circuiti, modelli matematici e lenti speciali, si costruisce il futuro degli smart glasses. Un lavoro, portato avanti in sinergia con gli scienziati di EssilorLuxottica, che richiede competenze trasversali e una visione condivisa, in cui ogni scelta progettuale – dalla forma di una lente alla posizione di un sensore – ha ricadute dirette sull’esperienza dell’utente finale.

Una ricercatrice analizza circuiti elettronici utilizzando un oscilloscopio, valutando le prestazioni di schede elettroniche durante una fase di test in laboratorio.

Eye tracking

L’eye tracking consente di tracciare i movimenti dell’occhio e di riconoscere il punto di interesse osservato dall’utente. Per esplorare questa tecnologia chiave degli occhiali smart e le sfide di ricerca da affrontare, abbiamo incontrato due ricercatori del Dipartimento di Elettronica, Informazione e Bioingegneria del Politecnico di Milano.

Marco Carminati è docente di Elettronica al Politecnico di Milano e project manager dello stream Eye Tracking per l’ateneo. Da sempre si occupa di sensoristica e microelettronica per sensori di luce, con una particolare attenzione all’optoelettronica. Accanto a lui, Marco Paracchini, giovane ricercatore in Telecomunicazioni, porta avanti la sperimentazione e lo sviluppo di nuove tecnologie per il tracciamento oculare.

Marco Carminati e Marco Paracchini

Di cosa si occupa lo stream Eye Tracking?

MC: Lo stream Eye Tracking riunisce competenze e tecnologie diverse, tutte orientate a un obiettivo comune: sviluppare sistemi in grado di seguire e tracciare i movimenti oculari. Negli occhiali smart, questa funzione ha una doppia utilità: da un lato, permette di guidare l’interfaccia uomo-macchina con lo sguardo; dall’altro, fornisce informazioni preziose abilitanti per la stima dello stato di salute e benessere psicofisico della persona, come il grado di affaticamento, concentrazione e attenzione. Sono circa trenta i ricercatori del Politecnico in questo gruppo, impegnati a trovare soluzioni che siano precise ma anche a basso consumo energetico, requisito fondamentale per i dispositivi indossabili del futuro.

Quali sono le principali tecnologie che state sviluppando?

MC: Attualmente, le soluzioni più diffuse si basano su microcamere a raggi infrarossi integrate nella montatura, ma queste richiedono molta energia e potenza di calcolo. Per questo stiamo esplorando diverse alternative come camere neuromorfiche che imitano il funzionamento dell’occhio umano, oppure sistemi ancora più semplici che utilizzano dei singoli fotorivelatori, realizzati tramite varie tecniche, per dedurre la posizione dell’occhio. Su quest’ultima tecnologia, uno dei principali stream è guidato da Marco Paracchini.

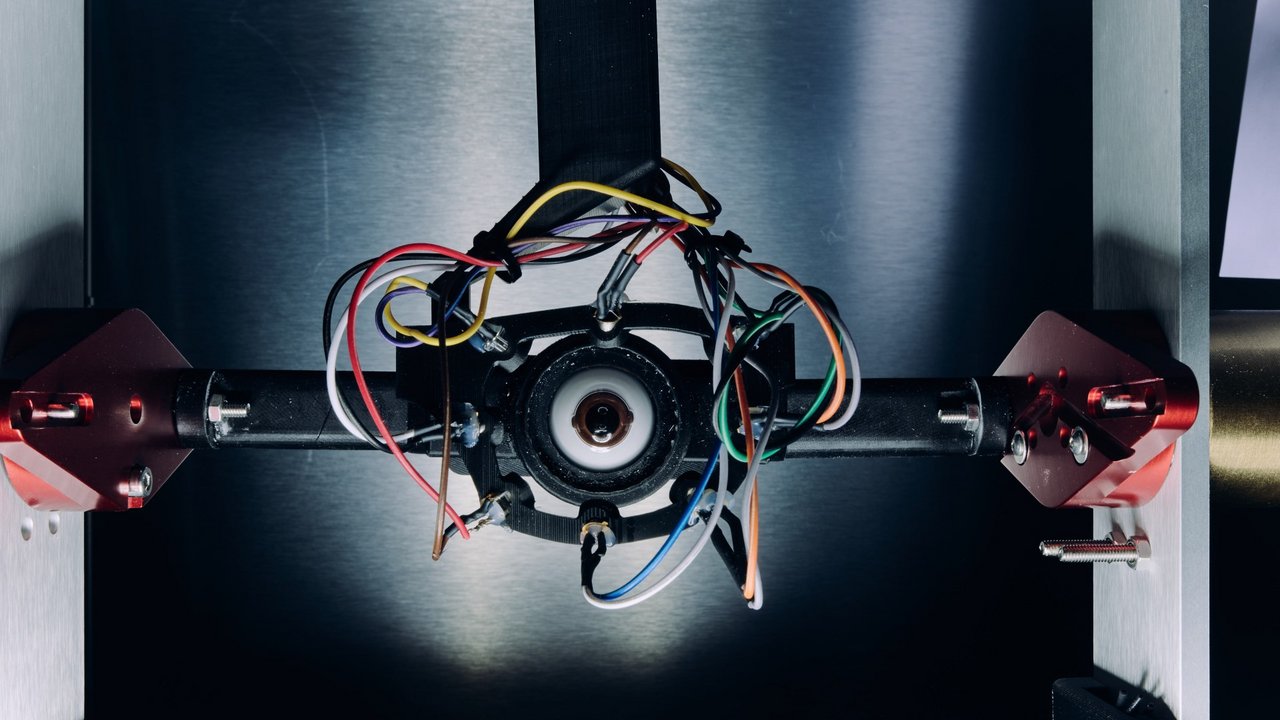

Sensori integrati nella montatura di un occhiale per misurare parametri e movimenti dell’occhio.

Set-up di test e sviluppo con modello di occhio realistico.

Marco Paracchini, raccontaci il vostro progetto

MP: Stiamo lavorando su una tecnologia che sfrutta un insieme di LED e fotodiodi montati sull’occhiale. I LED illuminano l’occhio e, in base ai segnali raccolti dai fotodiodi, possiamo dedurre la posizione dello sguardo. Una delle sfide principali è la robustezza: la conformazione del viso varia da persona a persona e questo influenza i segnali acquisiti. Si tratta di una tecnologia già nota, ma allo Smart Eyewear Lab stiamo studiando ulteriori sviluppi. Per rendere il sistema più adattabile, stiamo facendo diversi test sia su sistemi meccanici, come il giroscopio che muove un occhio sintetico, sia su sistemi robotizzati di movimentazione di occhi artificiali.

Quali sono le altre sfide tecnologiche che state affrontando?

MP: Un aspetto critico è lo “slippage”, cioè il piccolo spostamento degli occhiali rispetto alla posizione ottimale. Questo può alterare i dati raccolti, quindi i nostri algoritmi devono essere in grado di adattarsi in tempo reale. Inoltre, tutto il sistema deve funzionare su chip molto compatti e a bassissimo consumo, integrabili direttamente nella montatura. Abbiamo già dei prototipi in tal senso.

MC: Ottimizzare gli algoritmi per piattaforme “low power” è una delle sfide più innovative. I sistemi tradizionali impiegati nella sensoristica si appoggiano su computer o smartphone, che utilizzano processori piuttosto potenti. Noi cerchiamo il giusto compromesso tra semplicità e accuratezza, sfruttando metodi statistici e di machine learning per ridurre il carico computazionale. Per fare ricerca su questa ottimizzazione, lavoriamo su tre livelli: simulazione numerica, test su occhi artificiali e validazione in contesti reali.

Parte del team di Eye Tracking

Quali applicazioni può avere l’eye tracking negli occhiali smart?

MC: Si dice, in modo un po’ poetico, che l’occhio è lo specchio dell’anima; per la ricerca scientifica questo è in parte vero: possiamo dire infatti che l’occhio è lo specchio del cervello. I movimenti oculari riflettono lo stato di salute, la concentrazione, la fatica. Un tracciamento continuo, reso possibile dagli smart glasses, potrebbe in futuro offrire strumenti utili anche in ambito medico, ad esempio per screening o monitoraggio di alcune patologie.

Un’altra applicazione importante per noi è sicuramente il miglioramento dell’interfaccia uomo-macchina: l’eye tracking ci permette di tracciare dove l’utente sta focalizzando la propria attenzione, ad esempio su un display di realtà aumentata che proietta informazioni su una lente. Per dirla in maniera semplice, significa usare gli occhi al posto del mouse.

Qui troviamo l’aspetto sfidante della ricerca perché i sistemi di eye tracking, utilizzati per lo più nelle ricerche sull’ergonomia e negli studi di marketing, analizzano scene bidimensionali; inoltre, in questi casi i dispositivi vengono indossati dall’utente per un tempo limitato e per uno scopo circoscritto. La vera sfida che stiamo affrontando allo Smart Eyewear Lab è quella di rendere questa tecnologia non solo adattabile ad una scena tridimensionale, ma anche trasparente e indossabile tutto il giorno, entrando a far parte della vita quotidiana delle persone.

MP: Il panorama delle applicazioni dell'eye tracking è ampio; l'obiettivo del nostro stream non è concentrarci su una o più di esse, ma è quello di sviluppare soluzioni tecnologiche abilitanti. Queste tecnologie potrebbero permettere, ad esempio, di scattare foto che non riprendano tutta la scena, ma solo la parte su cui l’utente sta concentrando la sua attenzione; oppure potrebbero essere utili per la sicurezza alla guida, monitorando che lo sguardo sia rivolto sulla strada. L'eye tracking può anche rendere più accessibili i dispositivi a persone con disabilità, permettendo, ad esempio, di comporre frasi o selezionare oggetti sullo schermo semplicemente con lo sguardo.

A che punto è la ricerca rispetto ai prodotti già in commercio?

MC: L'Eye tracking è una tecnologia già matura, ma le tecnologie che stiamo sviluppando saranno probabilmente parte di una generazione futura di occhiali smart e non sono ancora presenti negli occhiali attualmente sul mercato. Sicuramente nel mondo industriale c’è molto interesse nel trasformare gli occhiali in un dispositivo tecnologico in grado di potenziare le funzioni umane. Questa attenzione potrebbe accelerare il passaggio dal laboratorio al prodotto.

In questo senso un centro di ricerca come lo Smart Eyewear Lab è strategico, perché unisce l’esperienza nei materiali, nell’ingegnerizzazione e nella fabbricazione di un’azienda leader nel settore come EssilorLuxottica e le competenze di elettronica, informatica e fotonica di un’università importante come il Politecnico di Milano.

Raccontateci com’è lavorare allo Smart Eyewear Lab

MP: In laboratorio c’è molta contaminazione tra diversi ambiti di ricerca: dall’hardware e dall’elettronica al software e agli algoritmi. Mi è capitato di occuparmi di una grande varietà di cose: mettere a punto sistemi meccanici, acquisire e analizzare dati, sviluppare algoritmi. È un’attività a 360 gradi, che mi ha permesso e mi permette tuttora di crescere molto.

MC: Lo Smart Eyewear Lab è un vero punto di incontro tra università e industria, ma anche tra gruppi di ricerca diversi del Politecnico. Qui studenti, dottorandi e ricercatori con background differenti si incontrano ogni giorno per collaborare, uniti da un obiettivo comune e allo stesso tempo ambizioso. È un ambiente giovane, dinamico e ricco di contaminazioni; penso che questo aspetto sia di enorme valore.

Camera e sensoristica

Per trasformare gli occhiali in dispositivi capaci di percepire e interpretare il mondo circostante, lo Smart Eyewear Lab ha dedicato uno stream di ricerca all’integrazione delle camere e dei sensori negli occhiali. Due ricercatori del Politecnico di Milano, Andrea Giudici, ingegnere elettronico, e Simone Mentasti, informatico, ci raccontano i risultati raggiunti e le sfide tecnologiche da affrontare nel campo della microelettronica e dell’intelligenza artificiale.

Andrea Giudici e Simone Mentasti

Raccontateci il vostro percorso

SM: Ho studiato informatica e ho poi svolto un dottorato multidisciplinare che ha coinvolto meccanica e informatica. Il progetto di dottorato, finanziato da Regione Lombardia, aveva come obiettivo la realizzazione di un veicolo autonomo. Mi sono occupato di sensoristica e acquisizione dati, fondamentali per il riconoscimento di veicoli, pedoni e segnali stradali. Dopo il dottorato, ho continuato a fare ricerca nel laboratorio AIRLab del Politecnico di Milano, dove mi occupo di analisi dati da sensori, soprattutto in ambito robotico.

Quando è nato l’accordo di collaborazione tra Politecnico ed EssilorLuxottica, per me è stato naturale dare il mio contributo allo Smart Eyewear Lab. Per gli occhiali smart, infatti, l’analisi dei dati sensoriali è uno strumento fondamentale per capire cosa sta facendo l’utente e cosa sta succedendo nell’ambiente circostante.

AG: Ho studiato ingegneria elettronica al Politecnico e ho proseguito con un dottorato, durante il quale ho lavorato su due progetti. Uno con NASA in cui mi sono occupato di sviluppare circuiti integrati per applicazioni Lidar da satellite; l’obiettivo era quello di effettuare un’analisi stratografica dell’atmosfera e dei primi metri dell’oceano, arrivando ad individuare le zone di fitoplancton, microrganismi fotosintetizzanti alla base della catena alimentare marina. Il secondo progetto era con HFSP (Human Frontier Science Program), il cui scopo era di vedere e studiare la struttura dinamica 3D su scala atomica di una proteina mentre svolge la sua funzione biologica e come essa varia nel tempo. Ho anche partecipato attivamente alla nascita e allo sviluppo di una startup nel settore automotive, occupandomi della progettazione, prototipazione e industrializzazione di prodotti elettronici.

Anche per me l’ingresso nello Smart Eyewear Lab è stato naturale: finito il dottorato, cercavo una nuova sfida e ho colto subito l’opportunità.

Di cosa vi occupate nello stream Camera e sensoristica?

AG: Il mio gruppo, composto da ricercatori e studenti, si occupa dello sviluppo dell’hardware: progettiamo e realizziamo l’elettronica che deve essere integrata nell’occhiale, tenendo conto di vincoli molto stringenti. L’occhiale è piccolo, deve essere comodo e bello da vedere; quindi, ogni componente elettronico deve adattarsi perfettamente alla geometria e al design della montatura. Lavoriamo a stretto contatto con EssilorLuxottica, che ci supporta anche nella parte meccanica e fornisce le linee guida per l’ergonomia.

Una volta scelti e posizionati i componenti, la nostra attività non si ferma qui: dobbiamo testare e programmare l’elettronica. Scriviamo il firmware, cioè il codice che permette all’unità di processing di dialogare con tutte le periferiche: camere, sensori, microfoni, accelerometri. La sfida è notevole perché la batteria è piccola, lo spazio è limitato per contenere, ad esempio, tutta l’elettronica con gli ingombri dei componenti tradizionali.

SM: Il mio gruppo lavora sugli algoritmi di intelligenza artificiale che analizzano i dati provenienti dai sensori. Gli occhiali devono essere “intelligenti”: capire cosa fa l’utente, dove si trova, cosa succede intorno a lui. Il problema è che non possiamo usare gli stessi modelli AI complessi che girano su un server, perché i microcontrollori degli occhiali hanno una potenza diversa e vincoli di memoria e di consumo energetico. La nostra ricerca punta a sviluppare algoritmi semplici ma efficaci, capaci di interpretare immagini e segnali in tempo reale, direttamente sull’occhiale.

Quali informazioni possono dare gli occhiali smart?

SM: Un esempio concreto: gli occhiali possono riconoscere che l’utente si trova in una riunione o alla guida e disattivare le notifiche per evitare distrazioni. Per farlo, i modelli AI analizzano principalmente le immagini acquisite dalle telecamere integrate, perché sono ricche di informazioni. Tuttavia, processare immagini è costoso dal punto di vista computazionale, quindi spesso integriamo anche dati da altri sensori, come microfoni e accelerometri, per alleggerire il carico.

Posizionare camere e sensori all’interno di un occhiale ha maggiori vantaggi rispetto al posizionamento, ad esempio, in un orologio. Se vogliamo capire cosa sta facendo l’utente e il suo contesto, la camera sugli occhiali è molto più funzionale: adotta lo stesso punto di vista dell’occhio e “vede” esattamente ciò che vede l’utente.

In cosa si differenzierà la futura generazione di occhiali smart rispetto ai prodotti già esistenti?

AG: La grande sfida è far sì che tutto il processing avvenga direttamente sull’occhiale, senza inviare dati a uno smartphone o a un server esterno. Questo è importante sia per la privacy (ad esempio, il GDPR vieta l’invio di immagini di persone a server esterni) sia per l’efficienza energetica. Stiamo inoltre studiando nuovi sensori, sempre con l’obiettivo di ridurre i consumi e ottimizzare l’elaborazione dei dati.

Parte del team di Camera e sensoristica

Come pensate che evolverà il vostro stream nei prossimi anni?

AG: Gli algoritmi evolvono rapidamente, ma lo sviluppo dell’hardware è più lento. Ora stanno nascendo nuovi acceleratori neurali che emulano il funzionamento del cervello e promettono consumi minori. Questo è un aspetto fondamentale se si pensa che la batteria degli occhiali smart è circa venti volte più piccola di quella di uno smartphone.

Il mercato è comunque molto attento a questi prodotti e gli investimenti sono in crescita. Diverse startup stanno lavorando su nuovi acceleratori neurali, e questo potrebbe favorire ulteriormente l’innovazione.

Quali sono stati i momenti più significativi della vostra ricerca?

AG: Nel mio percorso di ricerca ho avuto tante soddisfazioni, perché ho affrontato sfide che non avevo mai incontrato prima. Ogni volta che una nuova scheda elettronica funziona è una grande gioia per noi, perché dietro c’è un lavoro di mesi e addirittura anni. Vedere le prime immagini video catturate dal nostro dispositivo è stato emozionante, perché in quei momenti abbiamo visto tutti i singoli pezzi su cui abbiamo lavorato integrarsi perfettamente e funzionare insieme.

La cosa più bella è sapere che è nato tutto quanto in questo laboratorio: dall'idea di come far funzionare l'hardware al firmware fino al modello finale.

SM: Anche per me le soddisfazioni come ricercatore sono tante. In questi tre anni di lavoro allo Smart Eyewear Lab abbiamo scritto pubblicazioni, partecipato a conferenze internazionali e organizzato workshop. In queste occasioni abbiamo visto il nostro lavoro di ricerca riconosciuto a livello globale.

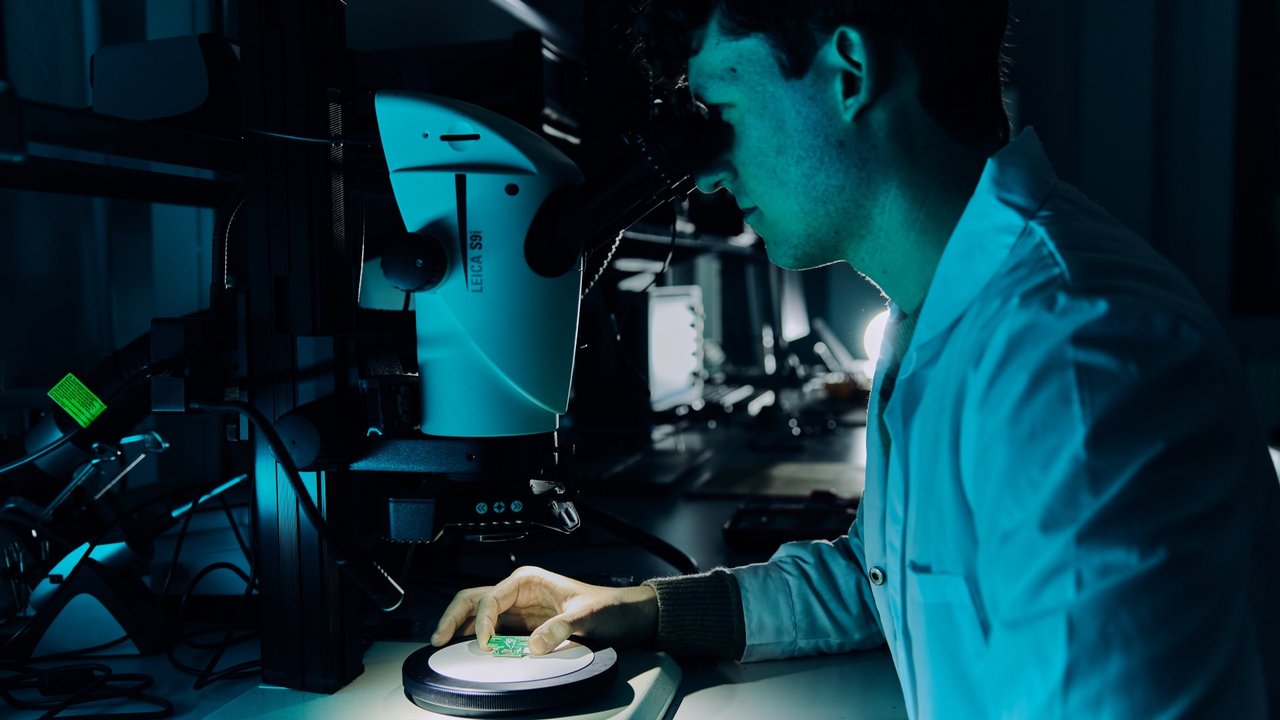

Un ricercatore osserva componenti elettronici e schede attraverso un microscopio,

esaminando i dettagli costruttivi e le connessioni durante un’analisi di laboratorio.

Cosa differenzia l’esperienza di ricerca allo Smart Eyewear Lab dalle altre collaborazioni?

SM: Al Politecnico abbiamo tante collaborazioni con aziende e nella mia carriera accademica ho lavorato spesso a progetti industriali. Allo Smart Eyewear Lab la collaborazione tra università e azienda è però quotidiana e molto stretta. In un laboratorio congiunto gli obiettivi sono condivisi e di lungo termine, e questo crea una visione comune tra i gruppi di ricerca.

AG: Uno degli aspetti più stimolanti è la collaborazione tra diversi gruppi di ricerca. Qui la contaminazione delle competenze è continua: tra ingegneri elettronici, informatici, biomedici e molti altri. Penso che sia una ricchezza fondamentale e necessaria quando si lavora su sistemi complessi.

Integrazione ottica

Tra le sfide più importanti per la futura generazione di occhiali smart c’è la creazione della realtà aumentata utilizzando l’olografia per proiettare immagini tridimensionali realistiche. L’esplorazione di soluzioni possibili in questo campo tecnologico all’avanguardia e molto sfidante è affidata allo stream di Integrazione ottica. Abbiamo incontrato Marco Astarita e Alessandro Cerioni, dottorandi del Politecnico di Milano, e il professor Gianluca Valentini del Dipartimento di Fisica, per farci raccontare la loro ricerca in un settore dove fisica, ingegneria e innovazione si intrecciano ogni giorno.

Gianluca Valentini, Alessandro Cerioni e Marco Astarita

Raccontateci di voi e di come siete arrivati allo Smart Eyewear Lab

MA: Sono originario di Napoli e ho studiato Fisica all’Università Federico II. Mi sono avvicinato all’olografia durante la tesi, lavorando sulle applicazioni per la litografia. Tre anni fa, quando lo Smart Eyewear Lab era ancora un’idea in costruzione, un conoscente mi ha segnalato che cercavano persone con competenze in ologrammi per la realtà aumentata. Ho partecipato al bando di dottorato perché era il progetto più ambizioso e stimolante che avessi trovato.

AC: Vengo da Jesi e ho studiato Ingegneria Fisica al Politecnico di Milano. Avevo vinto una borsa di dottorato a Stoccolma, ma il giorno prima di firmare il contratto il professor Valentini mi ha parlato del progetto dello Smart Eyewear Lab. Ho deciso di rischiare e sono venuto a Milano, anche se non era il mio campo principale perché avevo lavorato principalmente sui superconduttori. Grazie anche a Marco, sono riuscito a colmare il gap e ora mi occupo di olografia applicata agli occhiali smart.

Di cosa si occupa lo stream di Integrazione ottica?

MA: Noi ci concentriamo sull’integrazione della realtà aumentata negli occhiali; dobbiamo cioè trovare il modo di proiettare immagini direttamente nell’occhio. Sulla carta l’olografia è una tecnologia molto promettente, perché permette di creare immagini realmente tridimensionali, rispettando tutti gli indizi visivi che il cervello usa per percepire la profondità. Tuttavia, l’olografia digitale, e soprattutto dinamica, è una tecnologia ancora in fase di perfezionamento.

AC: A differenza di altri stream, noi non abbiamo ancora un prototipo di occhiale con realtà aumentata: lavoriamo su un set-up da laboratorio, ridotto e posizionato su un tavolo ottico. Il nostro compito è quello di investigare e sviluppare la tecnologia, così che quando saranno disponibili i componenti per realizzare display olografici integrabili, noi saremo pronti. È un po’ come nel quantum computing: si sviluppano i fondamenti tecnologici e gli algoritmi avanzati in attesa che l’hardware sia all’altezza.

Di ologrammi si parla tanto, ma la tecnologia sembra essere ancora lontana.

MA: Spesso la parola “ologramma” viene usata impropriamente. Quello che si vede ai concerti o su alcuni smartphone non sono veri ologrammi, ma effetti ottici come il Pepper’s Ghost o i display stereoscopici. Queste tecnologie danno solo una parvenza di tridimensionalità, ma mancano di molte proprietà che invece l’olografia può offrire. Ad esempio, la maggior parte dei display attuali utilizza la stereoscopia, ovvero crea immagini leggermente diverse per ciascun occhio, ma questo può causare disagio perché la percezione della tridimensionalità è in disaccordo con la convergenza dei bulbi oculari e l'accomodazione del cristallino. L'olografia invece risolve questo problema restituendo una percezione naturale della profondità.

Cosa rende l’olografia così speciale dal punto di vista tecnologico?

MA: La tridimensionalità di un ologramma deriva da molti elementi: colore, messa a fuoco a diverse profondità, e soprattutto dalla possibilità di ricreare la fase della luce, non solo la sua intensità. In pratica, l’olografia permette di ingannare il cervello facendo credere che la luce arrivi da un oggetto reale, non da un display. È come la differenza tra guardare la foto di una finestra e guardare attraverso la finestra: con l’olografia, quando cambi angolo di osservazione, cambia anche la prospettiva dell’immagine, proprio come accade nella realtà.

GV: Dal punto di vista fisico, tutto si basa sul controllo della fase della luce. Le lenti e i nostri occhi funzionano proprio così: la luce attraversa punti diversi della lente e arriva al fuoco nello stesso istante, cioè con la stessa fase. Un oggetto tridimensionale ha diversi piani di fuoco che il nostro occhio scansiona per percepirne la profondità utilizzando la contrazione del cristallino. Nei film tridimensionali, abbastanza popolari alcuni anni fa, l'occhio veniva ingannato con immagini diverse viste dai due occhi in modo da dare l'impressione che, ad esempio, un personaggio si avvicinasse a noi fino quasi a toccarci. Tuttavia, il piano di fuoco era sempre quello dello schermo perché l'immagine non controllava la fase della luce. Questo è un esempio concreto del disallineamento tra visione binoculare, convergenza e accomodazione di cui parlava prima Marco. Alcuni soggetti provavano nausea e disorientamento per questo problema, che vogliamo assolutamente evitare. L’olografia controlla la fase della luce per ricostruire immagini tridimensionali, mentre una fotografia tradizionale non può farlo.

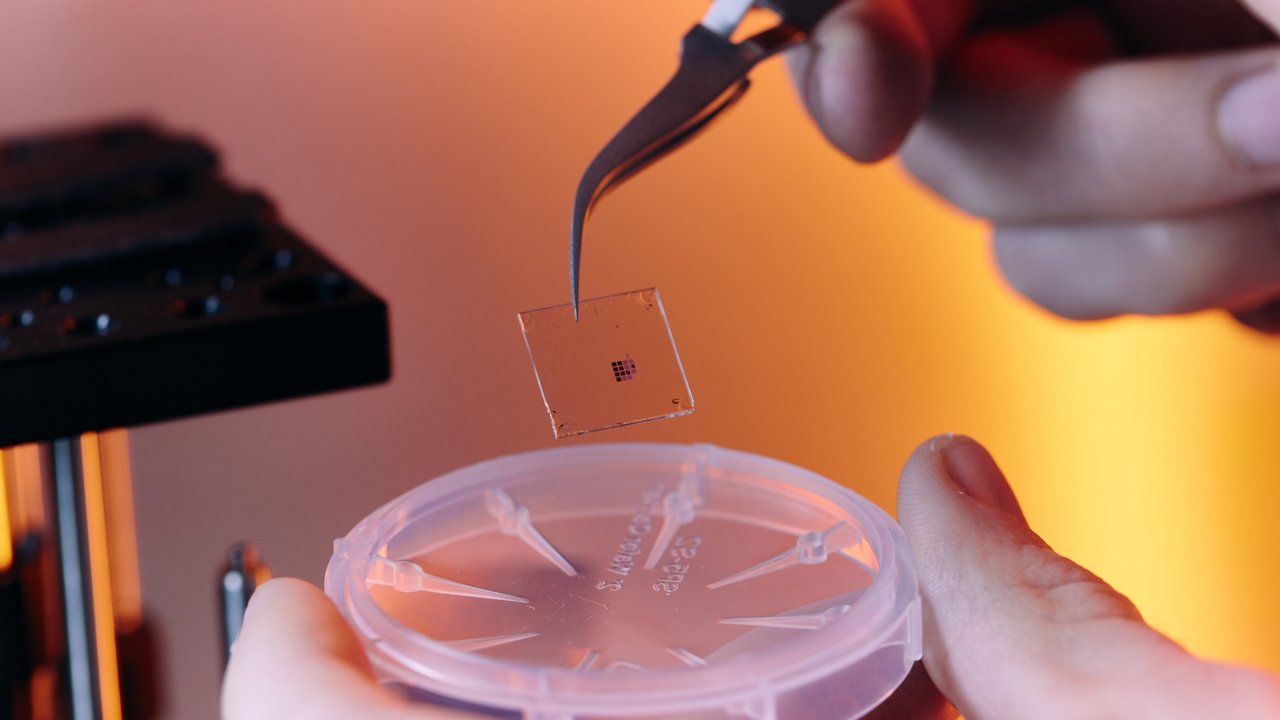

Le attività di ricerca dello stream optical integration spesso prevedono un primo livello di validazione

con set-up su tavoli ottici, allineati ed adattati alle esigenze dai ricercatori che lavorano in laboratorio.

Quali sono le principali sfide ingegneristiche che affrontate in laboratorio?

AC: Una delle attività più importanti è la riduzione del “rumore” negli ologrammi: non si tratta di suoni, ma di punti luminosi indesiderati che possono rovinare la qualità dell’immagine. Utilizziamo modulatori spaziali di luce per dare informazioni di fase, ma tra i pixel c’è sempre una parte di luce non modulata che va eliminata. Abbiamo sviluppato una soluzione proprietariache, come fanno le cuffie antirumore con il suono, crea un’onda luminosa “opposta” per cancellare il disturbo.

GV: La soluzione che abbiamo studiato per ridurre il rumore è innovativa perché a differenza di altre, non richiede hardware aggiuntivo perché usa lo stesso sistema per generare sia il segnale utile che quello di cancellazione. È un passo avanti importante verso la miniaturizzazione e l’integrazione di queste tecnologie in un occhiale.

MA: Il problema del rumore non è banale, perché partiamo da un fascio laser molto intenso che, se non opportunamente modulato, potrebbe essere molto fastidioso per l’occhio. La nostra soluzione distribuisce la luce in modo sicuro e confortevole, senza compromettere la qualità dell’immagine.

Quali sono le applicazioni pratiche della vostra ricerca?

MA: La parola chiave è realtà aumentata. Spesso si fa confusione tra realtà virtuale, mista e aumentata. La realtà mista combina contesto ambientale con immagini digitali; il contesto che vediamo non è propriamente quello reale, ma è un’immagine acquisita da videocamere e riproiettata. La realtà virtuale è invece completamente “artificiale” ed è possibile vederla solo utilizzando i visori.

La realtà aumentata, a cui puntiamo noi, permette di osservare il mondo reale attraverso lenti trasparenti, aggiungendo informazioni digitali e immagini 3D generate al computer senza alterare, sostituire o ri-acquisire digitalmente l’ambiente reale circostante. Possiamo mostrare indicazioni stradali, notifiche discrete o parametri vitali misurati dai sensori integrati nell’occhiale stesso, mantenendo la visione naturale del mondo. L’obiettivo non è cambiare il reale, ma aggiungere contenuti utili lasciando tutto ciò che è fisico esattamente com’è, per garantire naturalezza nelle interazioni con l’ambiente e soprattutto con le persone circostanti

GV: Fin dall'inizio del progetto, con EssilorLuxottica ci siamo dedicati allo sviluppo di tecnologie che potessero essere integrate in normali occhiali, con minimi compromessi in termini di peso e dimensione, per coerenza con la loro tradizione di eccellenza nell'occhialeria. Per questo non vogliamo creare visori ingombranti, ma occhiali che si indossano ogni giorno, belli e comodi come quelli tradizionali, ma con funzionalità digitali avanzate. È una sfida che unisce ricerca di base e applicata, e che può davvero cambiare il nostro modo di vivere la tecnologia.

Lo stream di Integrazione ottica si occupa solo di olografia?

GV: Un tema molto attuale sono le metasuperfici, che rappresentano l’evoluzione dell’ottica moderna. Si tratta di superfici sottilissime che possono manipolare la luce in modo molto più efficiente rispetto alle lenti tradizionali, permettendo di indirizzare la luce esattamente dove serve, ad esempio direttamente nella pupilla. Le metasuperfici sono un elemento centrale nello sviluppo degli smart eyewear perché potrebbero essere fondamentali per l’interfaccia tra occhio e lente.

Il protocollo di fabbricazione di una metasuperficie ottica prevede vari step di verifica,

fondamentali per l’ottimizzazione del processo.

Come si integrano le competenze accademiche con quelle industriali in questo progetto?

GV: Il progetto dello Smart Eyewear Lab rappresenta per il Politecnico di Milano un’esperienza davvero unica, sia per la modalità di collaborazione che per la sua portata. L’Ateneo è abituato a lavorare con le aziende su molti progetti di ricerca, ma con EssilorLuxottica abbiamo fatto un passo ulteriore: abbiamo creato un vero laboratorio congiunto, ospitato in un edificio dell’università, dove circa cento ricercatori del Politecnico e dell’azienda lavorano fianco a fianco ogni giorno. Si tratta di un’iniziativa senza precedenti nel panorama universitario italiano, sostenuta da un investimento di lungo periodo e di grande valore.

Questa collaborazione è diventata un modello di successo per il rapporto tra università e industria. Allo Smart Eyewear Lab la ricerca non si limita ad adattare tecnologie esistenti a scopi specifici, ma punta a creare nuove basi tecnologiche che potranno essere utilizzate per lo sviluppo degli smart eyewear del futuro. Per il Politecnico, è una straordinaria opportunità per unire la ricerca di base con quella applicata e per offrire a tanti giovani ricercatori la possibilità di crescere professionalmente in un ambiente stimolante e innovativo.