Alla 24ª Esposizione Internazionale della Triennale di Milano, il Politecnico di Milano firma un’installazione che usa l’intelligenza artificiale per farci vivere – in prima persona – le pieghe invisibili della discriminazione. Un colloquio di lavoro, tre avatar e cinque minuti che mettono a nudo i nostri automatismi.

Esistono esperienze che non si guardano soltanto: ti chiamano per nome, ti fanno domande, ti mettono a disagio. “Not For Her” è una di queste. Lontano dalla retorica della tecnologia che decide al posto nostro, l’installazione del Politecnico di Milano ribalta la prospettiva: l’AI non come giudice, ma come specchio. Un dispositivo che ascolta le parole, legge le espressioni del volto e restituisce, in tempo reale, l’eco dei bias culturali con cui conviviamo. In questa intervista, i professori Ilaria Bollati, Nicola Gatti, Matteo Ruta e Umberto Tolino, curatori dell’installazione, raccontano cosa significa progettare una macchina che crea consapevolezza; e perché, a volte, l’innovazione più potente è quella che ci chiede di fermarci cinque minuti.

Un’idea di:

Donatella Sciuto, Rettrice

Curatori dell’installazione:

Nicola Gatti, Responsabile Scientifico di FAIR (Future Artificial Intelligence Research)

Ingrid Paoletti, Delegata della Rettrice alle mostre ed eventi

Matteo Ruta, Professore Associato del Dipartimento di Architettura, Ingegneria delle Costruzioni e Ambiente Costruito

Con la direzione creativa di:

Umberto Tolino, Vicerettore per la comunicazione e le attività culturali

Ilaria Bollati, Ricercatrice del Dipartimento di Design

Com’è nata “Not For Her” e qual era la sfida iniziale?

Matteo Ruta: L’invito della Triennale è arrivato alla Rettrice del Politecnico con una richiesta chiara: portare un progetto che parlasse di intelligenza artificiale. Da subito abbiamo deciso che non sarebbe stata una mostra da guardare, ma un’installazione da vivere: un’esperienza interattiva capace di far immedesimare in una disuguaglianza e di stimolare la riflessione.

Nicola Gatti: La provocazione era evidente: AI e discriminazioni. Di solito l’AI viene accusata di amplificare i bias; noi volevamo ribaltare la narrativa dimostrando che, se progettata bene, può fare l’opposto: rendere visibili i pregiudizi umani e generare consapevolezza. Non raccontare una tecnologia “cattiva”, ma costruire un sistema utile e sotto controllo umano.

Perché avete scelto di concentrare l’esperienza sul tema di genere?

Matteo Ruta: All’inizio abbiamo valutato varie forme di diseguaglianza (età, etnia, orientamento…). Poi, per impatto e chiarezza del messaggio, abbiamo focalizzato il progetto sulla discriminazione di genere, anche per dialogare in modo coerente con il percorso complessivo della Triennale. La scelta della discriminazione di genere ci ha permesso di andare in profondità e di far emergere il conflitto in pochi minuti.

Ilaria Bollati: Volevamo che un’urgenza sociale diventasse un’esperienza da attraversare, non un semplice contenuto da guardare. Abbiamo scelto un allestimento essenziale e misurato, che lavora per sottrazione e lascia spazio all’empatia e all’accessibilità, un messaggio chiaro, intenso e leggibile, pensato per dare respiro allo sguardo e accompagnare, senza sovraccaricare, chi arriva da un percorso già denso di stimoli, proprio di una grande esposizione internazionale.

Umberto Tolino: È un tema cruciale anche per l’orientamento agli studi tecnico‑scientifici. Il focus sulle tematiche di genere ci ha permesso di sfruttare le competenze politecniche per la creazione di una rappresentazione verosimile sul divario che spesso attende studenti e studentesse al termine del loro percorso accademico.

In che cosa la vostra tecnologia è diversa dalle installazioni “interattive” tradizionali?

Nicola Gatti: Non è un albero di risposte precompilate. Il dialogo nasce dalle parole reali del visitatore; un sistema di AI generativa le interpreta e guida la conversazione dentro un canovaccio narrativo, mantenendo coerenza di contesto. È una macchina generalista, riprogrammabile: cambi i contenuti e cambi l’esperienza.

Ilaria Bollati: La tecnologia c’è, lavora e la interroghiamo, ma non si esibisce: sostiene l’esperienza e il contenuto. Non è mai fine a sé stessa, è al servizio del messaggio e di chi lo attraversa. Il sistema dialoga con la voce, ascolta le parole e legge le espressioni del volto del visitatore, modulando di volta in volta la risposta.

Umberto Tolino: I dataset utilizzati non provengono dalla rete in modo opaco: sono curati da docenti e ricercatori e la tecnologia è adottata per un fine culturale: sostenere un dialogo naturale e credibile senza esibire ciò che lo rende possibile.

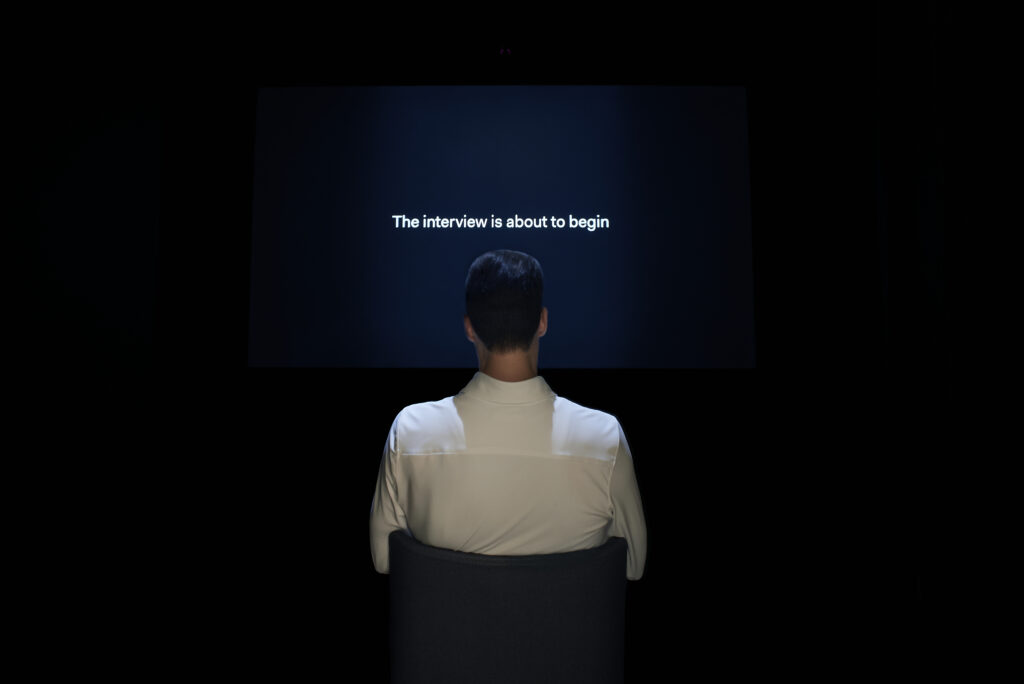

Matteo Ruta: Gli avatar sono tre, volutamente “sfumati” e non iperrealistici, a mezzo busto e posizionati come se fossero seduti, alla stessa altezza del visitatore, per favorire una postura più naturale. La stanza è buia per far funzionare audio e visione delle espressioni. Il sistema legge le emozioni sul volto e calibra la pressione del dialogo: se tentenni, incalza; se sei già teso, cambia registro.

Cosa succede dentro e fuori dal “cubo”?

Ilaria Bollati: Si entra scostando una tenda traslucida, una soglia che separa e prepara. Prima, uno spazio d’attesa discreto: sedute ordinate, tavolini bassi, libri da sfogliare, un invito alla conoscenza come gesto spontaneo. Alle spalle, una parete specchiante a opacità crescente riflette e poi sfuma, alludendo ai molteplici filtri e bias inconsapevoli che attraversano il nostro modo di vedere la realtà. Poi si prosegue, ci si siede di fronte ai tre avatar e il colloquio comincia.

Matteo Ruta: Volevamo che ognuno vivesse una traiettoria unica. Per questo il linguaggio cambia continuamente; ogni persona racconterà di un’esperienza diversa. Dentro, la sensazione è deliberatamente spiazzante: serve a togliere filtri e far emergere ciò che pensi davvero.

Umberto Tolino: Il design dell’esperienza è applicato in modo sartoriale: interfaccia naturale e pochi minuti per arrivare al punto. Al termine del colloquio non elenchiamo didascalicamente le discriminazioni vissute ma lasciamo all’utente un percorso di riflessione successiva.

© Luca Tralancia

© Luca Tralancia

Quali reazioni avete osservato? Che cosa state imparando dai dati?

Nicola Gatti: Il sistema ascolta il linguaggio naturale e gestisce il turn-taking; riconosce inoltre stati emotivi dalle espressioni del volto per modulare l’incalzare della ‘commissione’. Tutto avviene in modo trasparente per la persona, ma i dati sono anonimizzati e usati solo per finalità di ricerca e miglioramento dell’esperienza.

Ilaria Bollati: Oltre ai dati, integriamo il punto di vista dei mediatori culturali presenti in sala: un’osservazione continua e discreta del pubblico che ci restituisce feedback qualitativi da confrontare con quelli anonimi dei dialoghi.

Matteo Ruta: Un dato che colpisce: quando un uomo deve “inventare” Sofia all’improvviso, spesso la immagina giovane, neo‑laureata e in ambito culturale. Anche chi si considera sensibilizzato scopre di avere automatismi radicati. E questo è precisamente l’effetto specchio che cercavamo.

Umberto Tolino: L’installazione desta maggiore attenzione nelle donne disturbando gli uomini: ciò significa che la frizione con tali contenuti funziona. Non di rado alcuni uomini scelgono di non entrare affatto, davanti all’idea del colloquio: un rifiuto che parla, perché tocca atteggiamenti ricorrenti e noti. Sui dati definitivi attueremo un’analisi prudente, nel frattempo offriamo nell’allestimento (fisico e digitale) delle piste di lettura e bibliografia per chi vuole approfondire gli argomenti alla base del progetto.

Quanto è riprogrammabile questa macchina? E dove andrà dopo la Triennale?

Nicola Gatti: La piattaforma è modulare: cambiando contenuti e regole di regia, può diventare un dispositivo per la didattica, per il teatro e per altri tipi di progetti. Non è “la macchina della discriminazione”, è una macchina che oggi racconta quel tema.

Matteo Ruta: Sin dall’inizio l’abbiamo pensata trasportabile, per darle una seconda vita in Ateneo e altrove. I dati raccolti confluiranno in pubblicazioni scientifiche – ricerca aperta che altri potranno usare.

Umberto Tolino: Vogliamo valorizzare questo lavoro prolungando l’esperienza in momenti di public engagement: è una sperimentazione tecnologica e culturale che merita altre occasioni di diffusione.

Cosa significa “cultura politecnica” in un progetto come questo?

Umberto Tolino: Ingegneria, design, architettura, drammaturgia, ricerca sui contenuti e i dati: il progetto esiste perché tutte queste competenze hanno lavorato insieme. È la cifra stilistica del Politecnico di Milano, un’istituzione culturale capace di progettare mettendo le persone al centro: Technology for Humanity.

Che cosa vi ha lasciato, sul piano umano e progettuale?

Umberto Tolino: La gratificazione di un risultato corale, di qualità. Non un progetto individuale, ma dell’intera Istituzione. E la gioia di vedere tecnologia, contenuti e spazio suonare all’unisono.

Ilaria Bollati: La parola che mi resta è equilibrio: tra rigore e delicatezza, tra l’aprirsi al pubblico e il restare fedeli alla nostra identità scientifica e politecnica. Un lavoro umano, multidisciplinare, fatto di dialogo e ascolto.

Matteo Ruta: Sul piano umano mi ha colpito molto: pur occupandomi da anni di questi temi pensavo di essere ‘pronto’, e invece ti accorgi di quanto la tana del Bianconiglio sia profonda. Restano automatismi, c’è ancora tantissimo da fare, e in certi momenti ci rimani anche male. È importante che se ne parli, e che lo si faccia bene.

“Not For Her” dimostra che l’intelligenza artificiale può essere un’alleata nell’educazione civica: nel silenzio di una stanza scura, tre avatar e cinque minuti di dialogo bastano per farci inciampare nei nostri pregiudizi. Non predica, ti mette alla prova. E quando esci, le domande ti camminano accanto: è lì che cominciano davvero l’innovazione e la consapevolezza.